特邀国盛证券所长助理、计算机首席分析师【刘高畅】带来最新的观点。

1、产业变革看什么:巨大的潜在空间和颠覆性,落地速度快不是核心,空间大更关键。

2、DeepSpeed Chat的优势是效率和经济性比较好,它的效率比其他系统快15倍以上,且具有出色的扩展性支持,可以应用于各种模型。

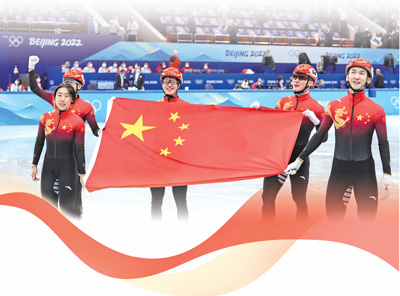

(相关资料图)

(相关资料图)

3、Deep Speed-Chat应用的三种方式:

第一种方式是通过 Fine-tune微调这种方式来进行行业化,和know-how的融合;

第二种方式是通过 plugin 接入到其他应用程序中,调用接口并使用其他工具;

第三种方式则是通过多模态的方式,使用的输入输出信号除了文字,还包括图像、视频输出信号以及机器人指令。

4、在应用的爆发后,推理侧的算力需求才是真正的爆发。使用量越大,对算力的需求就越高。

正文:

1999年整个互联网行业的发展特点:巨大的潜在空间和颠覆性

在之前的几次关于整个 AI 时代的分享中,我们在去年底所有的行业策略中强调了 AI 这一重要方向。然而,事实证明 AI 的演变速度和扩散程度超出了我们的预期。与去年年底我们撰写年度策略时相比,AI 在这几个月的演进中得到了质的提升。因此,我们将其作为几个主线中最核心的方向之一。

以前我们列出了三个并列的主线,但现在我们认为 AI 是首选的主线。市场和产业发生了许多变化,主持人刚才也提到了 "AutoGPT" 和 "DeepSpeed chat"。市场有许多相关认知和领域方面的错误理解,我们今天分享的重点是这个行业的最新更新,帮助大家理清思路。

从行业中期的角度来看,我们之前撰写了一份有趣的报告,分析了 1999 年互联网市场。我们认为,从产业的角度出发,我们应该淡化对投资本身的理解,那么这些年唯一可比的科技周期就是 1999 年。因此,我们回顾了当时的互联网行情,并发现它们有几个特点。

它们都是巨大的行业变革,同时处于产业的早期阶段,因此很难看到营收和盈利的变化。在早期阶段,甚至产品形态、商业模式和竞争格局都不是很明确。然而,它们最可比的特点是具有巨大的潜在空间和颠覆性。

当我们回顾1999年整个互联网行业的市场表现时,发现它的持续时间远比大家预期的要长。这一行情从1998年7、8月开始,一直持续到2000年年底。在这一过程中,出现了许多倍数增长的牛股,股票的涨幅多达8倍、10倍或者15倍,甚至更多。

因此,在大型科技行业的早期,整个产业积极地拥抱了这种新技术的变革,全社会也响应积极。市场也会给予这种可能性极强的奖励。这一轮人工智能的发展,与当时的情况非常相似。巨大的技术变革和极大的社会影响力,它的影响不仅限于计算机行业的400家公司,也不仅限于A股的4000家公司,它影响的是全体民众的生活和工作,以及整个社会形态。它有可能极大地提升社会生产力,为我们民众带来巨大的便利性。但同时,它也具有极强的颠覆效应。因此,某些行业可能会受到影响,整个形态也可能会发生较大的变化。

DeepSpeed Chat的优势和应用

近期的 DeepSpeed Chat很多公众号报道时写得非常夸张,称其为“全民大模型”,好像这样的大模型开始变得不值钱了,但事实上,DeepSpeed Chat并不是一个训练预训练大模型的工具,它更多的是在预训练好的大模型的基础上进行强化学习调优,也就是所谓的Fine-tune或微调方式。虽然绝大多数大模型具有非常强的通用性,但在具体细分领域可能无法提供足够的准确性。

例如,如果将 ChatGPT在3.5阶段的模型用于医疗诊断,准确率可能只有 87%。因此,我们需要使用行业化、专业的数据和知识,以及know-how来训练模型,使其成为一个准确性更高的医生。

在这个过程中,Fine-tune需要特定领域的数据,以及一定模型的基础,在传统原有模型的基础上,再来训练提高准确性。这种过程类似于强化学习, Deep Speed-Chat 主要加速的就是这个环节。该引擎具有三个主要优点:

第一个优势是效率和经济性比较好,它的效率比其他系统快15倍以上。它相对高效地利用了GPU,不像其他方式可能只能利用GPU的10%或甚至5%性能。

第二个优势是它具有出色的扩展性支持,可以应用于各种模型,不仅仅是像Hugging Face的Bloom这样的模型,还包括像openAI的ChatGPT,GPT-3还有各类的GPT3模型。它一天之内的训练速度也很快,可以对一个庞大的175B模型进行Fine-tune。并且它的算力消耗也很亲民,只需要一个GPU就可以支持超过130亿个参数的模型。

Deep Speed-Chat会带来非常明确的影响,应用主要通过三种方式:

第一种方式是通过 Fine-tune微调这种方式来进行行业化,和know-how的融合;

第二种方式是通过 plugin 接入到其他应用程序中,调用接口并使用其他工具;

第三种方式则是通过多模态的方式,使用的输入输出信号除了文字,还包括图像、视频输出信号以及机器人指令。通过使用 DeepSpeed Chat,也可以降低某些工程难度,使中小型应用程序制造商能更轻松地将 ChatGPT 用于各种应用程序,如医生、老师、金融分析师等,并且可以用于其他方案。

因此,整个 ChatGPT 的可能性扩张速度将会加快,这种完整的开发工具对应用的成型有非常强的帮助。

另外一点容易被误解的是,使用DeepSpeed Chat后,训练时需要的大量算力就会缩减,但事实上,这种观点是有偏差的。正如我们之前所提到的,在整个训练过程中,包括预训练阶段和强化学习阶段,还有很多InstructGPT 的过程,这是一个教育和指导的过程,就像我们教小孩子一样,我们会指导他们遵循正确的指令和提升道德水平。预训练阶段,包括编写代码的阶段更多地提高了它的逻辑水平。

相比于预训练阶段,强化学习在整个训练过程中所需的计算资源占比非常小,如果仅仅是强化学习的话,它可能只占整个训练过程的千分之一以下。

但结合一些其他的 Fine-tune,可能需求会多一些。但总体而言,在整个训练过程中,它的占比会非常少。

另一个知识点是,在强化学习中训练的占比已经足够小了。在整个模型的训练和推理过程中,我们认为在应用的爆发后,推理侧的算力需求才是真正的爆发。使用量越大,对算力的需求就越高。

相对于训练端,这种需求可能是5倍、10倍,甚至更高。因此,需要多少算力取决于应用。DeepSpeed Chat加速了各种应用的落地,因此我们认为中期算力需求有望迎来一个极大的爆发。

AutoGPT是什么

很多人关注AutoGPT。AutoGPT是一种自主反馈和改进的行为。初始时,它有许多身份设定和目标存在。该产品展示了整个流程,并提供了一些演示和连接,比如你可以输入AI名称和角色来定位身份。在此输入的AI是为了自动发展和实现商业目标,如增加净值。

所以交易中的 GPT是指定增加净值的,设定五个目标是为了完成任务。GPT 开始产生逻辑链以实现这些目标,给出理由并制定计划。完成目标的计划通过反思和下一步操作来实现。这个过程循环不停以达到目标。

在这个例子中,展示了一个 Chef GPT,即厨师的 GPT。它的设计初衷是通过浏览网页和观察事件来创造一个独特的菜单,这个菜单能够与特定的主题相匹配。它的一个目标就是发明一个不在菜单中的菜谱,然后将其保存下来以适应这个特定事件。在完成这个目标前,它会不断推导和搜索相关的新闻和事件,以形成新的菜单。如果没有形成菜单,它会将其跳过并继续搜索,这个过程中会有不断的思考。

AutoGPT就是这样的一个过程,它把 GPT融合起来,形成了一个能够自我反馈、自我思考,不断去演绎逻辑的方案。等于把一个简单的指令和目标指出来后,让它发散,然后让它去审视之后的结果。

所以 AutoGPT是一个很有意思的产品,它的应用空间也比较大,给一个简单的指令,就可以不断的去扩展、去融合,所以想象空间就比较大。这里强调一下,微软 Copilot 大家也看得比较多了,SAM也是大家最近看的比较多的一个方向。事实上,SAM并不能够取代机器视觉,因为 SEM 只是去分割任务,大家可以看到这个我们分割出来的效果,如果分割的效果比较好,那么识别的准确率也会大大提高。

互动环节

见智研究:对于DeepSpeed Chat 来说,企业会用到开源的模型对这种类 ChatGPT 进行微调,那么对企业来说他们可能会遇到哪些难点?

刘高畅:

对企业来说的,首先还是要有一定的大模型的知识,也不是说所有企业的都有微调的基础,也是需要专业的团队来做。

第二点就是在微调的过程中,都是为了强化某一个领域的效果,这个时候,需要对这个场景有一个好的理解,并且要结合所需要的场景和应用,然后储备足够好的数据。

不是泛泛而谈的数据,而是真的对这种场景应用有很大支撑的数据,然后进行强化学习和训练,才能很好地提升这个领域的效果。

第三点,对企业来说,Fine-tune强化学习的过程当中,不只是单单地把它的专业度提升,它还有一个优点就是我们可以把这个模型做小,因为大家知道大模型的参数规模都会比较大,对算力的消耗也比较大,那么在推理应用端的话经济性不足。

那么Fine-tune 的微调,所需要考虑的就是有没有办法在保持效果的情况下,把模型做得相对来说小一些,那么它的经济效益就会更好。

见智研究:怎样看待中小企业自己研发大模型的路径?

刘高畅:

中小企业研发大模型,就是你也不能太小,因为我们考虑过你这个模型需要先做大再做小,你即使做行业模型,一般来说也是这种多模态的模型,基本上模型规模我们认为融合起来至少也是在 500 亿参数以上,纯视觉大模型你是可以做到几十亿参数的,不过那个意义不大。

一旦和 GPT 融合,然后用这种视觉大模型的形式,我们认为至少有一定的泛化能力,至少应该是在一个小几百亿参数,这个是必须的。小几百亿参数,这种行业的模型要达到比较好的效果和比较好的应用,我们认为整个研发的投入,应该也在一两个亿以上。而且它对于这种人才的储备,还有行业的客户数据的储备,还有 know-how 的储备,其实要求都还是比较高的。

所以我们认为很多初创公司有人才的基础上,它是可以做这样的大模型的,但是对所有的绝大部分的中小企业来说,我们认为这个门槛相对来说比较高,所以尽量不要一开始就做大模型,最好是结合一些比较成型的,比如说像开源的hugging face等等。

见智研究:对专用领域的企业来说是否会倾向于模型压缩以及本地化的部署?

刘高畅:

对很多场景来说模型压缩应该就是蒸馏和裁剪这两个方式,这个是一定会做的。我们刚才讲 Fine-tune的时候,它也进行了这种方式。所以你在具体的细分行业,你是可以蒸馏和裁剪的比例是比较高的。像ChatGPT ,它在应用的过程当中它为了保持通用性,它大概裁剪的模型规模,就是对算力的损耗大概是降低了90%。那可能在细分的领域来讲,这种模型的蒸馏和裁剪我们认为应该是可降低在 90% 以上,好的话可以在 95% 以上这样的水平。本地化部署,我们觉得相对来讲难度会比较高。

见智研究:对于开源模型来说,开源商的授权问题是否值得关注?

刘高畅:

开源商的授权问题是肯定需要关注的,因为无论是在这种 GitHub 还是像 hugging face 里面,如果自己用还好,但是如果说来进行这种商业化去推广,你的整个合法性就会受到考验。在一些非允许的区域或者说领域内,你用它的底层的模型,开源模型做训练。就像我们之前,比如中国软件以前做操作系统这种服务器操作系统,它的麒麟操作系统的底层可能是 CentOS。一旦把这一块禁了之后,大规模的商业化就会受影响,很多客户也会不愿意用这样的一个合法性存疑的模型,所以在商业化的过程中是受影响的。但是在这个自己就是说单独使用的过程当中,这个是不受影响的。

见智研究:Meta 的SAM 模型在是否在产业当中已经有一些最新的进展了?

刘高畅:

SAM它整个推出来的时间不长,我们这里也讲了它的功能主要是分割,也叫 segment anything model,然后它这里面其实是融合了很多算法,包括像 ViT 这种算法一些思想也是融在其中。这个后面就是它对这种通用的视觉。比如说在机器人的运行过程当中,那么它可以去区分,要让每一块物体进行这种自动的分割,然后你的注意力注意到哪个模块,它才进行这种识别。

那这样的自动分割,然后再加识别的方式,它对节省算力,还有像人一样的这个智能其实是非常像的,就是我们一看看到眼中的图像当中,我们可以其实知道是很多模块,但是我们不仔细去看某一个领域,我们可能很多细节很多点是看不清楚的。那么它这个就是先分割,然后再重点关注再识别,这个可以大大的去提升视觉的效率还有准确度。

见智研究:多模态在视频应用上有什么最新的进展?

刘高畅:

多模态视频这个其实是大家的一个误区,大家觉得视频才是真实的世界,但实际上视频的话就是一秒 24 帧的这个图片。在多模态发展到今天的话,其实产业都在进步。在分割的这个环节上有 SAM 出来,然后在识别的这个环境上,我们也看到了像这种 Google 2 月份发的这个ViT-22B,也就是大家讲的这个视觉大模型,真正就真的把这个大模型从 30 亿参数扩展到了 220 亿,再加上这样的一个图生文的模型之后,我们看到 GPT 的发展有这种智能化的这个反馈了。

现阶段我们看到的是搜索辅助编程、聊天机器人的应用,但是未来我们会看到很多这种简单多模态的方案,像这种智能家居的工业视觉,工业检测,通用的AGV等等。

落地速度快其实不是一个选择的标准,未来的发展空间大才是最好的一个选择标准。现阶段的话我们看到的比较快的是搜索,是辅助的编程,是各种聊天机器人的变种落地快,在中期来看的话,既能快速落地,又有比较大的空间。我们看到是 office 类的工具,简单多模态的这种方案,行业的专家智能助理,接下来的这个半年到 3 年内,应该会给大家不断地产生各种各样惊喜。

未经授权,禁止转载。